在windows 电脑上运行开源LLM大语言模型本来门槛挺高的,但是现在只要你的电脑配置能运行基本模型,使用Ollama 就可以快速在本地电脑搭建一个大模型的服务。

Ollama 官网:https://ollama.com/

先在Ollama官网下载windows 的对应安装包。下载比较慢,可以等待一下,如果有网盘会员可以使用百度网盘之类的远程任务先下载到网盘,再下载到本地,这样会快很多。

Ollama 下载地址windows 10 及以后系统支持:

https://ollama.com/download/OllamaSetup.exe

注意给自己的C盘保留大概20G左右的空间用来安装Ollama 运行环境和下载对应模型,比如 llama3.1 的模型就需要5G的存储空间。

Ollama 直接给你简化了大模型运行所需环境。无需关心太多配置项信息,只需要开箱即用就行。

安装完Ollama后在应用中打开软件,在角标处就出现了羊驼的标志。

这样打开windows 的win+R ,输入CMD,进入命令行模式。

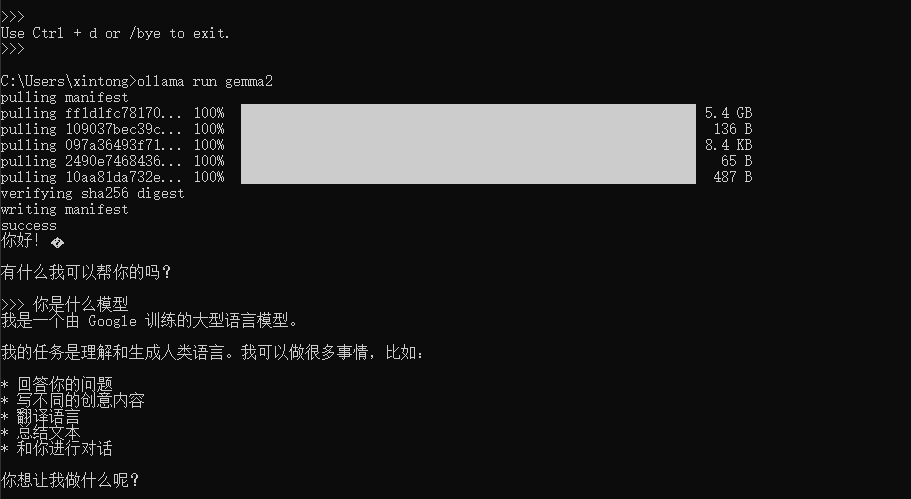

执行ollama 官网模型里面复制的指令,等待安装完成就可以使用模型的交流模式了。

llama3.1 模型的的下载和运行链接。

https://ollama.com/library/llama3.1

比如这就是llama3.1 模型的8b的执行命令

ollama run llama3.1

在命令行模式下 按 ctrl+d 退出 ollama 模式。

然后我又安装了gemma2 的模型,随时切换模型使用即可。

ollama run gemma2

如果你想要使用类似chtgpt的聊天界面,可以使用 脱胎于ollama 的webui 项目 openwebui。

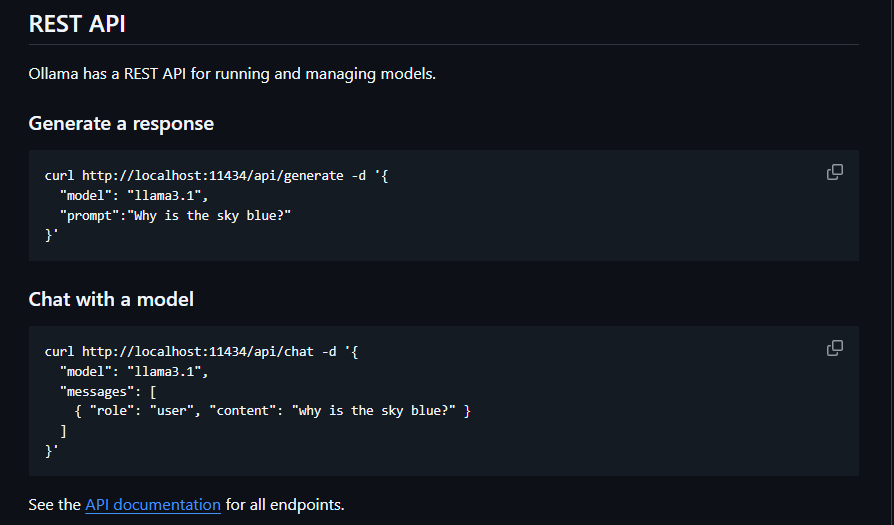

如果你希望通过API方式调用本机的模型能力,可以参照如下接口文档调用:

https://github.com/ollama/ollama/blob/main/docs/api.md

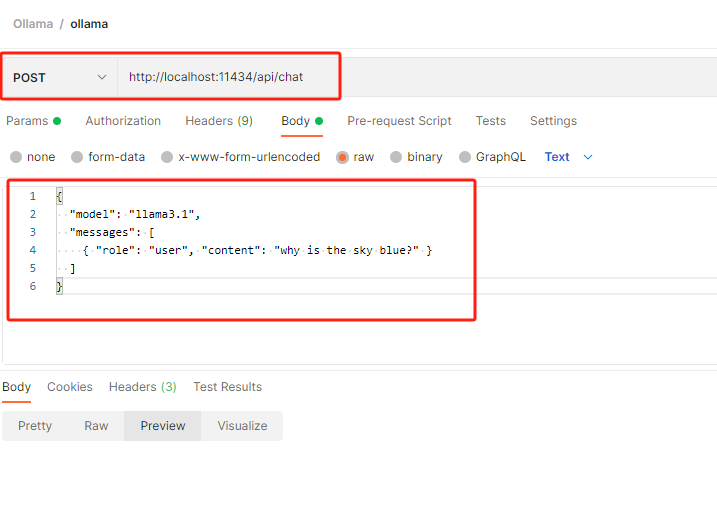

使用postman测试接口返回。